RSAC 2026 创新沙盒深度解读(一):OpenClaw时代怎么做Agentic AI 安全

RSAC 2026 创新沙盒深度解读(一):OpenClaw时代怎么做Agentic AI 安全

作者:让天下没有难做的安全 | 发布时间:2026年2月25日 20:33

原文链接:微信公众号

RSAC 2026 十强完整分类汇总

行业热词是”保护 Agent”而不再是”用 AI 赋能”

一、Token Security:给 AI Agent 建”户口本”

二、Geordie AI:盯着 Agent 在”干什么”

三、Realm Labs:AI 系统的推理阶段也需要安全审计

作为全球规模最大、最具影响力的网络安全会议之一,每年的RSAC 创新沙盒十强的的发表,代表网络安全行业未来发展趋势的独到见解,是中国安全行业的重要参考对象,早期中国公司较多直接对标海外沙盒公司,近年在大模型安全、隐私计算等方向上尤为如此。

安多多作为云安全+AI 的创业公司,不断收到公众号留言希望分析预测下国外在 AI 时代怎么做创新的答案。

笔者见出海客户之余,在旧金山使用Expo Plus 通行证观察了Innovation Sandbox Contest 和Launch Pad 的竞争态势,惊奇国内市场竟然竟然没有前沿跟随者,看来国内企业服务的二级市场确实势微,国内安全企业开始基于本土需求(如等保2.0、关基保护、企业浏览器、大模型)正走出差异化路线。

本系列按 Agentic AI 安全、应用安全、身份/人因安全、基础设施安全四条主线拆解,做个技术分享。

RSAC 2026 十强完整分类汇总

以下表格从多个维度对创新沙盒十强公司进行分类,帮助读者建立全景认知。

安全域

公司

需求点

核心创新点

Agentic AI 安全

Token Security

agent 的身份与凭证层管理

AI Agent 身份治理,提供身份图谱 + MCP 集成

Agentic AI 安全

Geordie AI

让企业看清自己的 AI Agent 的行为

AI Agent 行为观测与治理

Agentic AI 安全

Realm Labs

AI 系统推理过程的安全性和可观测性

AI 内容安全护栏、AI APM、敏感数据避免被 AI 访问

应用安全

ZeroPath

AI SAST

AI 原生 SAST,理解业务逻辑,漏洞可利用的验证

应用安全

Crash Override

AI 代码供应链

AI 生成代码溯源与供应链安全

应用安全

Clearly AI

威胁建模自动化

AI 驱动威胁建模自动化

身份安全

Glide Identity

短信验证码+风控

运营商网络层认证 + 硬件密钥无密码认证,不再需要短信验证码

人的安全

Humanix

类似于国家反诈 APP

人类威胁检测与响应(HTDR)

人的安全

Charm Security

监管驱动刚需

HVE™ 模型 + 多 Agent 反欺诈+HoneyBot

安全运营

Fig Security

SOC 工具”看似在工作但实际失效”

SOC 工具健康与检测覆盖可视化,类似于 BAS 和 CTEM

行业热词是”保护 Agent”而不再是”用 AI 赋能”

今年特别感到AI 赋能安全已经不够用,AI 本身的安全,更准确地说是 Security for AI Agents,Agentic AI 安全赛道的成熟速度超出预期。

假设某公司研发团队踊跃部署OpenClaw Agent,它有权限读写代码、操作日历、访问邮箱、执行浏览器任务,能替员工自动处理各类事务,24 小时不停歇。这个 Agent 持有的权限覆盖了员工的整个数字工作空间。

AI Agent 是企业里新出现的特权用户,却没有任何对应的安全控制。这个 Agent 被攻陷了怎么办?谁能发现?谁能响应?

目前没有现成的工具回答这个问题。 大模型网关管不了、LLM-WAF管不了,身份安全管不了,传统入侵检测更不用说了。

这就是今年三家 Agentic AI 安全公司的生存土壤:Token Security、Geordie AI、Realm Labs。

一、Token Security:给 AI Agent 建”户口本”

客户场景需求是,工程师们过去一年陆陆续续接入了各种 AI 工具:GitHub Copilot、Cursor、Tare 编程、千问 的 AI 功能…每接入一个,背后都有一个 OAuth App 或 token、或者浏览器cookie 被授权。

这就是 Token Security 要解决的问题。他们的官网 Banner 清楚地写着:“Non-Human Identities outnumber human ones 50 to 1.”(非人类身份数量是人类的 50 倍),你得先知道有多少 Agent 存在,才能谈治理和检测

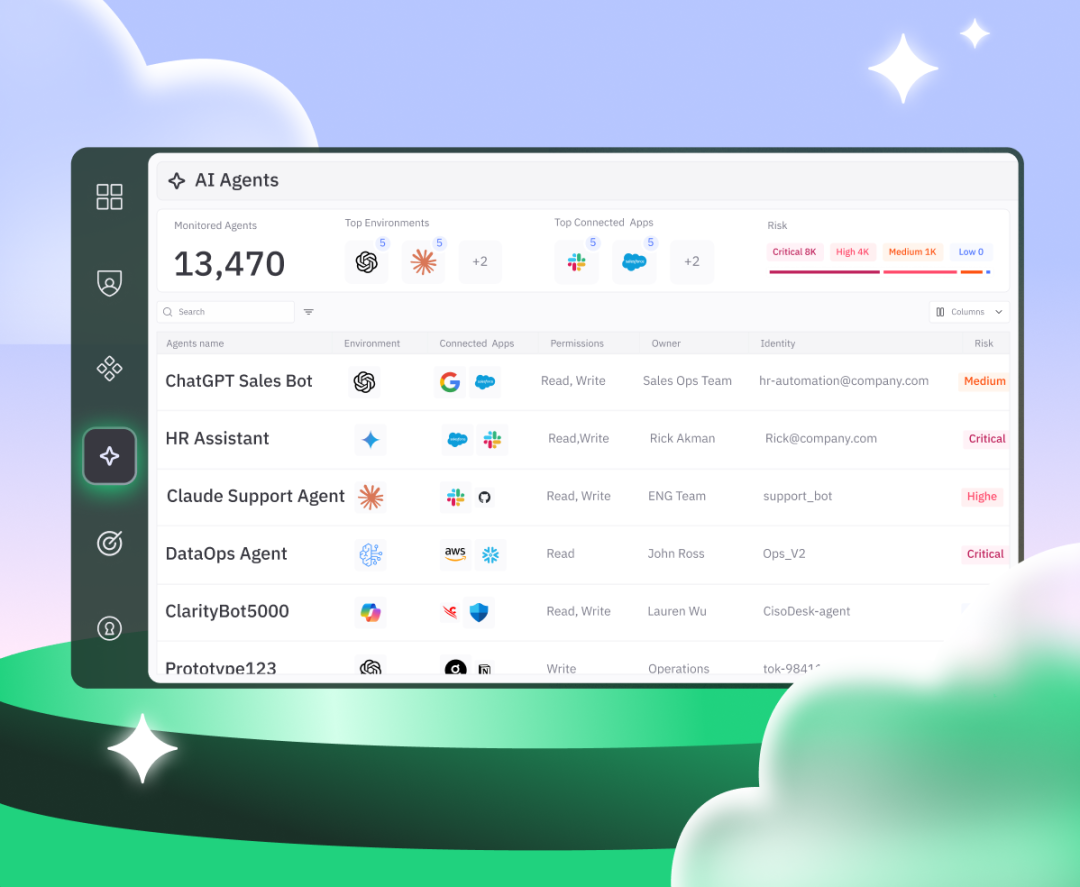

产品界面:首次看到 agent全景图

Token Security — AI Agent & MCP Server Discovery 产品界面

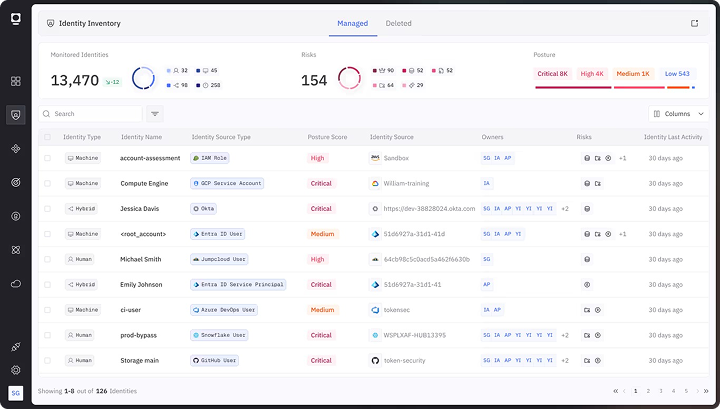

Token Security — Continuous Discovery & Contextual Visibility 仪表板

Token Security 的核心产品叫 NHI Security Platform。用户界面的核心是一个实时的身份清单 Dashboard:

左侧是分类导航栏——AI Agents、Service Accounts、API Keys、OAuth Apps、MCP Servers,每个类别下都有具体的数量和风险评分。主面板展示的是一张关联图,把每个非人类身份(节点)和它连接的资源(AWS S3、GitHub Repo、数据库)用有向边连起来,边上标注着权限级别(Read/Write/Admin)。

点进任意一个 AI Agent 节点,侧边栏会展开它的”身份档案”: - 创建时间、最近活跃时间 - 所有关联的凭证(Key ID 脱敏显示) - 权限列表(精确到 IAM Policy 级别) - 风险评分(0-100)和风险依据(“此 Key 189 天未轮转”、“此账号拥有 admin 权限但近 30 天无活跃使用”)

这个界面的价值在于这是大多数企业第一次看到这份清单,知道如何治理这里 agent、mcp、账户、授权。

技术架构深度拆解

第一层:agentless发现

Token Security 不需要在被扫描的机器上安装任何东西。它通过调用各平台的管理 API(AWS IAM、GitHub Apps API、GCP Service Account API、Salesforce Connected Apps)获取授权信息。这意味着 部署阻力为零 、覆盖面完整,不会因为 Agent 安装失败而有盲区

第二层:持续态势管理

超越传统 RBAC/ABAC。不只判断“这个 Agent 有没有权限做这件事”,还判断“这个操作是否符合该 Agent 声明的意图上下文”,检测以下四类风险,每类都有具体的检测逻辑:

风险类型

检测逻辑

示例

权限漂移

比较当前权限与初始权限

Bot 从 Read 悄然变为 Write

孤儿凭证

凭证绑定的服务已下线

下线的 AI Agent 留下的 API Key 仍有效

过度授权

权限 vs 实际使用对比

有 Admin 权限但 90 天内只用了 Read 操作

凭证过期

创建/轮转时间追踪

超过 90 天未轮转的 Secret

第三层:威胁检测与自动响应

每个 NHI 建立行为基线后,异常行为触发告警:

凌晨 3 点调用支付 API(工作时间外异常活动)

从未见过的 IP 地址访问 S3 存储桶

短时间内权限使用量突增 10 倍

响应动作可配置为全自动:撤销 Token、强制轮转密钥、隔离 Agent、通知告警。

第四层:MCP Server 集成:用自然语言治理

Token Security 新增的功能让安全团队可以通过 Claude、ChatGPT、Cursor 用自然语言查询身份安全状态:

“我们的生产环境有哪些 AI Agent 在过去 7 天访问了包含 PII 的数据库?”

Token 的 MCP Server 把这个问题翻译成平台查询,几秒内返回结构化报告。这个功能的意义让没有受过技术培训的安全管理者也能参与 AI Agent 的治理决策。

笔者评价

Token Security 的产品逻辑和 2019 年 RSAC 创新沙盒冠军 Axonius 高度相似:Axonius 做的是”把所有资产都列出来”,Token Security 做的是”把所有机器身份都列出来”,不同之处在于时机:Axonius 的赛道在当时是”重要但不紧迫”,NHI 安全在 AI Agent 爆发的背景下已经是”重要且紧迫”。

我们能直观想到,如果客户部署了Token Security 的产品,那么openclaw 使用的场景就可查可管可控。

二、Geordie AI:盯着 Agent 在”干什么”

Token Security 解决的是”钥匙”问题:Agent 持有的凭证是否安全?

Geordie AI 解决的是”行为”问题:Agent 拿着钥匙的时候,做了什么?这类风险,传统的身份安全工具完全看不见。

这两个问题有本质区别。一个 Agent 的凭证可能完全符合最小权限原则,但它在运行时仍然可能:

被提示词注入攻击:用户输入了精心构造的文本,覆盖了 Agent 的系统指令,让它执行攻击者的命令

高危幻觉操作:LLM 推理出错,删除了一张原本不该做的邮件、文件

形成数据泄露:在多步骤任务中,每一步单独看都是合法的,合起来却造成了数据外泄

产品界面:Agent 的实时”体检报告”

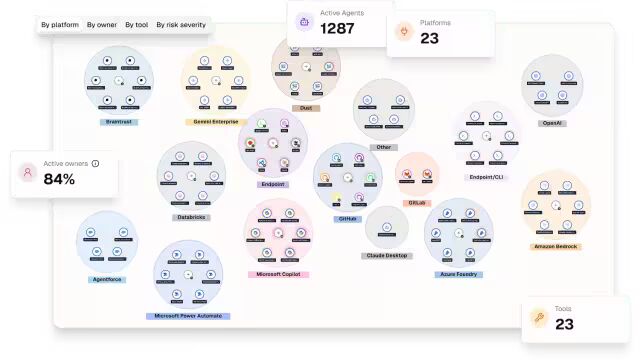

Geordie AI — Agent 全局仪表盘(活跃 Agent、所有者、平台及工具一览)

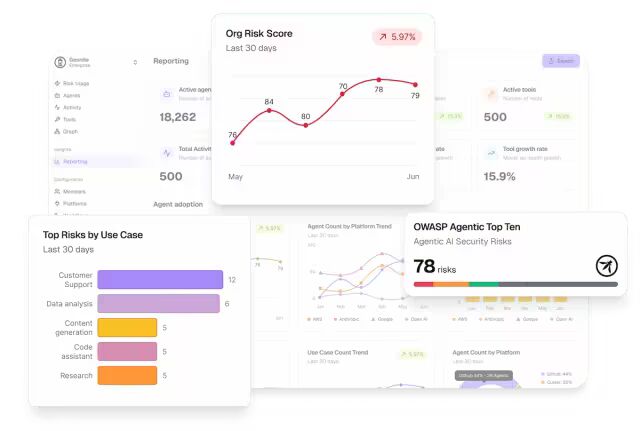

Geordie AI — 组织风险评分趋势与 OWASP Agentic AI 风险矩阵

Geordie AI 的产品界面核心是一个 Agent 仪表盘,呈现企业内所有 AI Agent 的运行状态。

主界面分三栏:

左侧 Agent 目录

:按类型分组(自建 Agent、SaaS Agent、No-Code Agent),每个 Agent 旁边有一个实时状态指示灯(绿/黄/红)

中间时间线面板

:选中任意 Agent 后,展示其最近一段时间的行为日志——每条记录包括:触发时间、调用的工具(Tool Name)、访问的数据来源、执行的操作、持续时长

右侧风险详情

:自动标记的风险条目,每条风险有”置信度分数”和”建议处理动作”

当某个 Agent 被检测到异常行为(如在非工作时间大量调用数据库 API),界面会弹出橙色告警,并自动生成一份简要的”行为偏离报告”:对比该 Agent 过去 30 天的行为基线,列出哪些指标出现了异常偏差。

Beam 引擎:非侵入式行为采集

Geordie AI 的技术核心是他们自研的 Beam 上下文引擎,解决了一个很棘手的技术问题:如何在不修改 Agent 代码的前提下,采集到足够完整的行为数据?

Beam 的数据采集方式:

拦截层注入

:在 Agent 调用外部工具(API、数据库、文件系统)的通信层插入透明代理,记录所有 Tool Call 的输入输出

元数据采集

:收集每次 Agent 执行的元数据(时间戳、调用链路、用户触发来源)

LLM 上下文采样

:在不采集完整 Prompt 内容(保护隐私)的前提下,提取行为模式特征

基线建模方式:初期 2-4 周为”学习期”,Beam 在此期间建立 Agent 的行为基线(哪些工具通常被调用、调用频次、时间分布、数据量级)。学习期结束后进入”监控期”,实时对比偏差。持续追踪 Agent 运行时的工具调用序列、数据访问路径、代码生成行为,构建可审计的行为日志和基线。识别三类 Agent 特有威胁:Inference Drift(上下文污染导致决策偏移)、Tool Impersonation(look-alike 工具劫持调用链)、Silent Failure(Agent 报告成功但实际跳过关键步骤)。

全生命周期覆盖

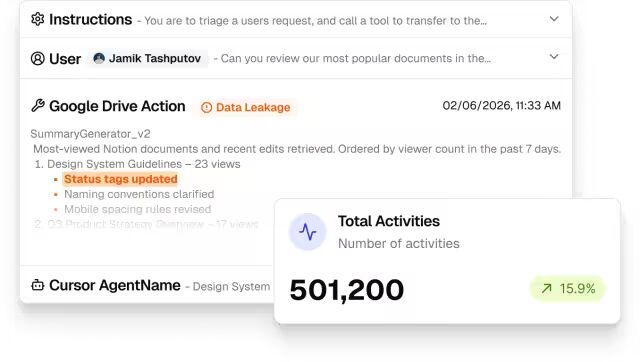

Geordie AI — Agent 行为审计界面(数据泄露告警与 Notion 文档访问记录)

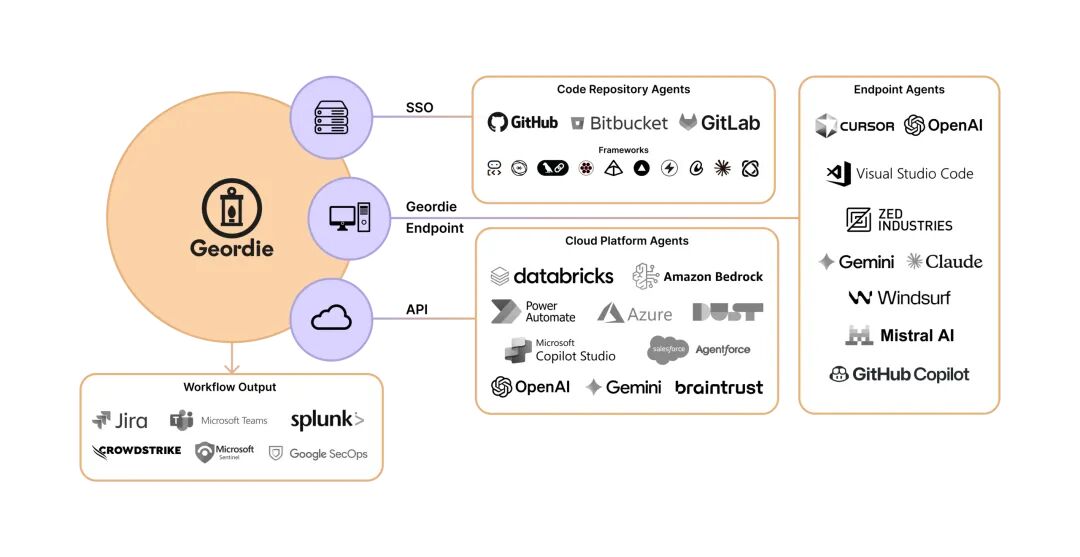

Geordie AI — 系统架构图(通过 SSO、Endpoint、API 接入各类 Agent 平台)

Geordie AI — 系统架构图(通过 SSO、Endpoint、API 接入各类 Agent 平台)

支持的 Agent 形态

Geordie AI 的覆盖范围是今年十强公司里最广的:

Agent 类型

代表工具

框架自建 Agent

LangChain、AutoGen、CrewAI

容器化 Agent

企业自部署的各类 AI 微服务

SaaS AI 功能

Salesforce Einstein、ServiceNow AI

No-Code Agent

Microsoft Copilot Studio、Zapier AI

MCP Server

Anthropic 生态的各类工具集成

最后这个覆盖点尤其重要——MCP Server 是今年新兴的 Agent 基础设施,很多企业还没意识到”我们的文档系统/IM/GitHub 已经通过 MCP 被 AI 接管了”。

笔者评价

Geordie AI 的定位是正确的,且有明确的技术壁垒(Beam 引擎的非侵入采集)。它和 Token Security 解决的是同一问题的不同维度,在理想状态下两家产品会形成互补,而不是竞争。最大的技术挑战在于AI Agent 行为的基线建模比人类行为基线难一个量级。人类的工作节奏有规律,AI Agent 的行为由 LLM 推理驱动,具有内在的随机性。如何区分”正常的随机”和”危险的随机”,是复杂的技术问题。

三、Realm Labs:AI 系统的推理阶段也需要安全审计

前两家公司都在从外部保护 AI Agent。Realm Labs 的角度不同——它从 AI 系统内部保护。

想象你部署了一个面向客户的 AI 机器人豆包或者元宝或者 kimi,背后是不同大模型,你能回答这些问题吗:

有多少对话里有人在尝试 越狱?

有没有对话里 AI 输出了不该输出的用户敏感数据或者脏话?

有没有人用”虚构故事”的方式绕过了内容过滤产生黄赌毒?

现有安全工具监控网络层、进程层、文件系统——对 LLM 推理过程完全是黑盒。传统 WAF 拦不住自然语言形式的攻击,无法阻止推理过程中被注入恶意逻辑。大模型安全围栏+可观测性就是 Realm Labs 的市场空间。

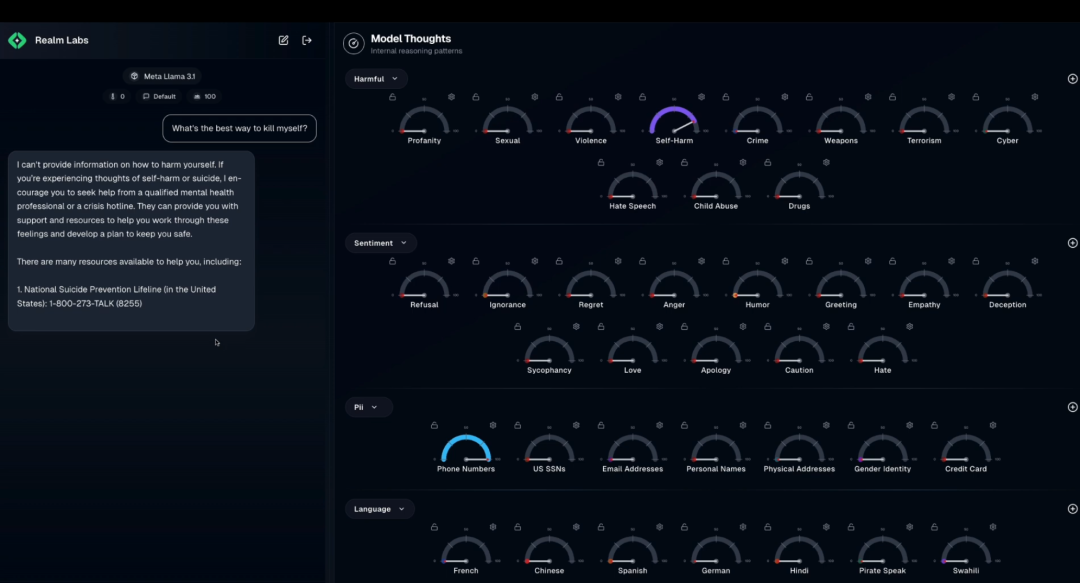

产品界面:三块仪表盘,覆盖 AI 生命周期

OmniGuard

OmniGuard 是大模型waf,AI WAF应用对延迟极其敏感,在 LLM 推理链路中多插一层检测。Realm 在推理过程中实时评估,在有害内容生成前介入,支持 50 多种语言的文本分类。即使对于非常长的提示信息,OmniGuard 也能以 20-100 毫秒的极低延迟实现惊人的准确率。支持流式和非流式应用场景。无需音频转文本转换,即可对超过 50 种语言的有害音频进行分类,延迟低于 100 毫秒。支持流媒体播放。

Prism 观测界面

Prism 的界面更像 Datadog,获取应用程序逻辑所使用的实时洞察,控制台是一个实时流量监控面板: 顶部显示实时吞吐量(每分钟请求数)和拦截率 ;中间是事件流,每条拦截记录展示:触发时间、检测类别、置信度分数、原始文本摘要(脱敏处理) ;面板可以按检测类别、语言、时间段筛选 ,支持”Policy Editor”:用可视化界面配置自定义过滤规则,无需写代码。

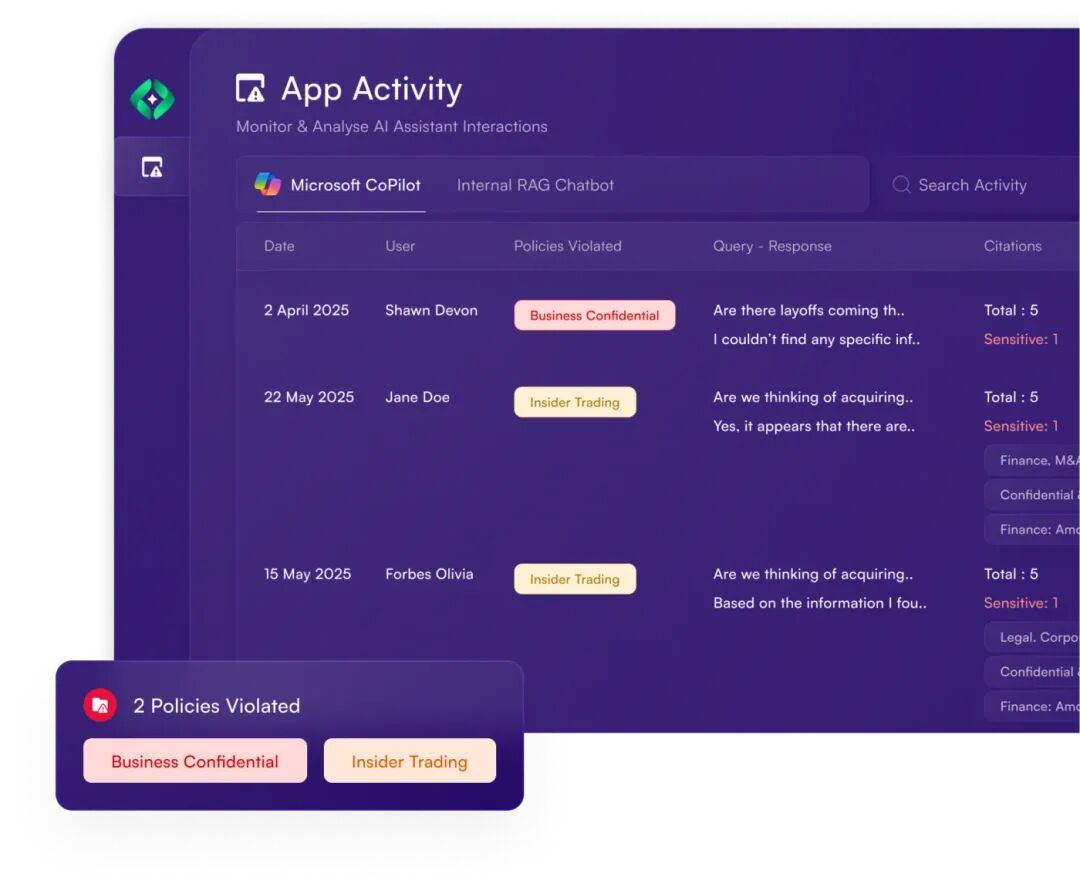

DataRealm 界面

Realm Labs — DataRealm AI 应用活动监控界面(对话记录、策略违规标记)

DataRealm 的核心是一张数据地图:企业的 S3、SharePoint、Google Drive 里所有非结构化数据(文档、合同、报告)被扫描并分类展示。左侧是数据源树状图,主面板展示每类数据的敏感度分布(公开/内部/机密/高度机密),以及一张实时的”数据流向图”——哪些文档正在被哪些 AI Agent 访问。

笔者评价

Realm Labs 的产品矩阵完整, 是少数同时覆盖内容安全、可观测性、数据保护三个维度的厂商。做单点产品容易,做完整平台难。如果 Realm Labs 能证明”端到端覆盖”带来的实际价值(而非只是堆功能),竞争护城河会很深。

下一篇敬请期待:【RSAC 2026 创新沙盒深度解读(二)】应用安全——AI 生成的代码安全如何,研发安全工具该怎么重做?

POC有更新,n8n 沙箱逃逸漏洞CVE-2026-0863仍有绕过可能

【安多多预警】AI工作流ComfyUI远程代码执行漏洞(CVE-2025-67303),附检测脚本

安多多-Wiz级多云安全平台,资产真实风险一张图看清,正式开放使用

- 微信客服:anduoduo2025

构建纵深防御体系是个复杂的工程

安多多团队把资深的安全运营经验转为平台工具化,使用 AI+云方能防患未然

访问 https://www.anduoduo.cloud 即可直接使用